في ورقة بحثية جديدة. اقترح مهندسو شركة Apple الاحتفاظ بمعلمات LLM على فلاش NAND الخاص بجهاز iPhone بدلاً من ذاكرة الوصول العشوائي المفقودة.

وقد شهد هذا العام تحولات جذرية في التكنولوجيا الكبيرة حيث حل الذكاء الاصطناعي محل الميتافيرس باعتباره السبب الرئيسي للإنترنت. فجأة، أصبح الجميع يصنعون نماذجهم اللغوية الكبيرة (LLMs)، ولكن معظمها يعمل في السحابة باستخدام أجهزة خادم قوية. لا تحتوي الهواتف الذكية على ذاكرة كافية لتشغيل الطرازات الأكبر والأكثر قدرة.

حلول شركة Apple

مع قيام شركات Qualcomm وIntel وغيرها بإضافة أجهزة التعلم الآلي إلى أحدث الرقائق. قد تحتوي أداتك التالية على ما تحتاجه لتشغيل الذكاء الاصطناعي المحلي. لكن المشكلة تتمثل في كبر نماذج اللغات. حيث يمكن أن يكون هناك تريليونات من المعلمات التي تحتاج إلى العيش في الذاكرة أثناء تشغيل النموذج، ولا تحتوي الهواتف على الكثير من ذاكرة الوصول العشوائي – خاصة هواتف Apple، التي تصل سعتها إلى 8 جيجابايت فقط في iPhone 15 Pro.

كما تأتي بطاقات تسريع الذكاء الاصطناعي التي تقوم بتشغيل هذه النماذج في مراكز البيانات بذاكرة أكبر بكثير من بطاقات الرسومات المماثلة. على سبيل المثال، يأتي Nvidia H100 مزودًا بذاكرة HBM2e بسعة 80 جيجابايت مقارنة بذاكرة GDDR6X بسعة 24 جيجابايت فقط في RTX 4090 Ti الذي يركز على الألعاب.

خطوات تحسين برامج LLM للهواتف المحمولةمن Google

تعمل Google على تحسين برامج LLM للهواتف المحمولة من خلال نموذج Gemini الجديد، الذي يتميز بإصدار “nano” مخصص للهواتف الذكية. ويهدف البحث الجديد الذي أجرته شركة آبل إلى حشر طراز أكبر في الهاتف الذكي من خلال الاعتماد على وحدة تخزين فلاش NAND، والتي عادة ما تكون أكبر بعشر مرات على الأقل من ذاكرة الوصول العشوائي للهاتف. المشكلة الرئيسية هي السرعة، حيث أن تخزين الفلاش أبطأ بكثير.

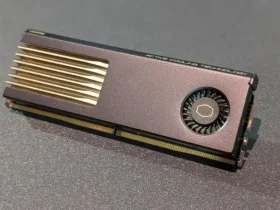

مكاسب سرعة أبل NAND

تدعي شركة Apple تحسينات كبيرة في السرعة عند ضبط استخدام NAND. الائتمان: أبل

وفقًا للبحث. استخدم الفريق تقنيتين لجعل نموذجهم يعمل بدون ذاكرة الوصول العشوائي. كلاهما يهدف إلى تقليل كمية البيانات التي يحتاج النموذج إلى تحميلها من وحدة التخزين. يسمح Windowing للنموذج بتحميل المعلمات لآخر عدة رموز مميزة فقط، وإعادة تدوير البيانات بشكل أساسي لتقليل وقت الوصول إلى التخزين. تم أيضًا استخدام تجميع الصفوف والأعمدة لتجميع البيانات بشكل أكثر كفاءة حتى يتمكن النموذج من معالجة مجموعات أكبر من البيانات.

كان البحث ناجحًا في توسيع قدرات iPhone LLM. باستخدام هذا النهج، حيث تعمل برامج LLM بشكل أسرع بمعدل 4 إلى 5 مرات على وحدات المعالجة المركزية القياسية و20 إلى 25 مرة أسرع على وحدات معالجة الرسومات. ولعل الأهم من ذلك هو أن iPhone يمكنه تشغيل نماذج الذكاء الاصطناعي ضعف حجم ذاكرة الوصول العشوائي المثبتة عليه عن طريق الاحتفاظ بالمعلمات على وحدة التخزين الداخلية. وخلصت الدراسة إلى أن هذا النهج يمكن أن يمهد الطريق لتشغيل LLMs على الأجهزة ذات الذاكرة المحدودة.

اقرأ أيضًا:

“منشآت” تطلق أداة نماذج الأعمال الأولى من نوعها عالميًّ

المصدر