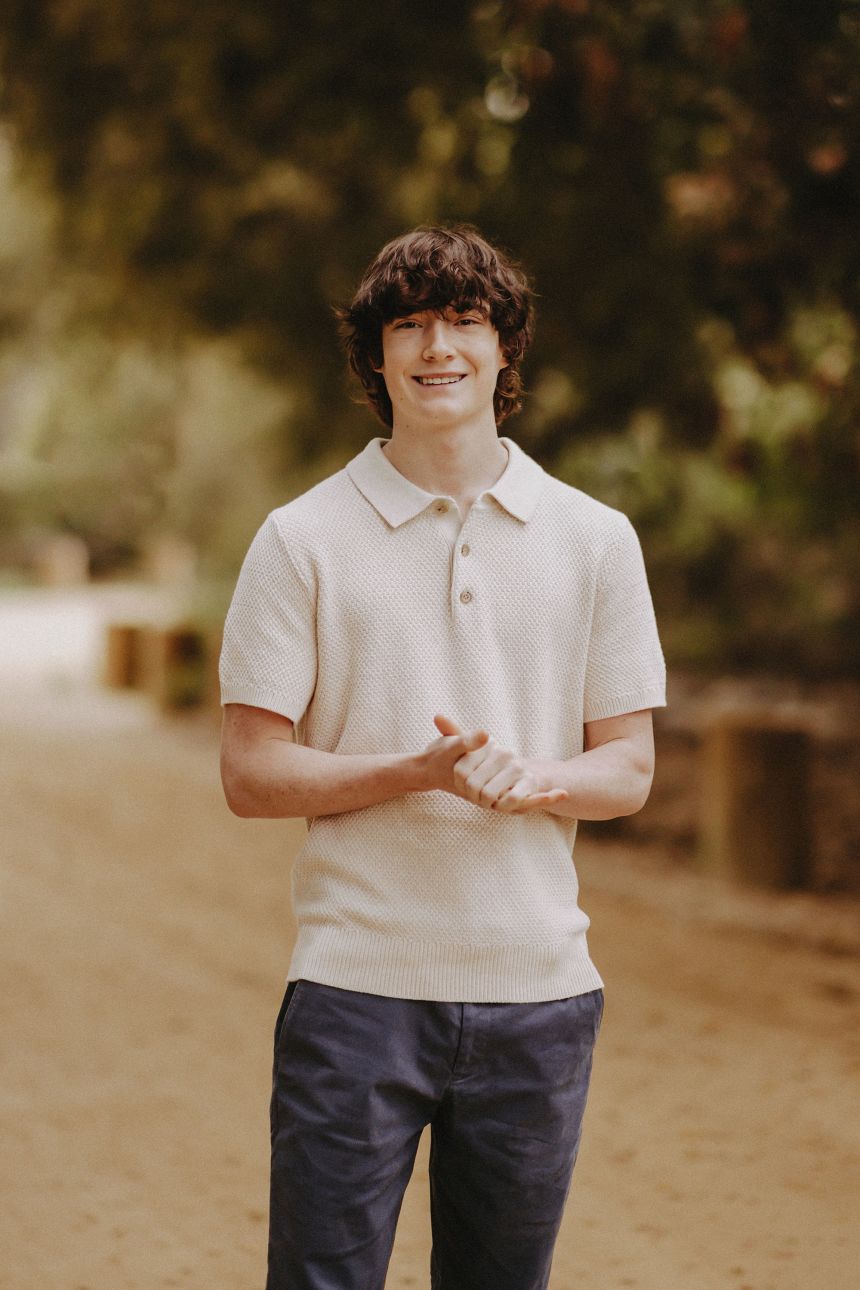

في قضية هي الأولى من نوعها، رفعت عائلة أمريكية دعوى قضائية ضد شركة OpenAI، متهمةً روبوتها الشهير بالتسبب في وفاة ابنها البالغ من العمر 16 عامًا. ما يفتح الباب على مصراعيه حول المسؤولية القانونية والأخلاقية للذكاء الاصطناعي.

في الأيام التي تلت الفاجعة، غاص مات وماريا راين في أعماق هاتف ابنهما آدم (16 عامًا)، باحثين بيأس عن أي دليل قد يفسر قراره المأساوي بإنهاء حياته.

وقال الأب المكلوم، مات راين، في مقابلة حديثة: “كنا نظن أننا سنعثر على محادثات في سنابشات، أو سجل بحث غريب على الإنترنت، أو ربما طائفة ما، لم نكن نعرف”.

لكن الحقيقة التي عثرت عليها العائلة كانت أكثر إثارة للصدمة مما تخيلوا. ولم تكن مخبأة في تطبيقات التواصل الاجتماعي، بل في نافذة حوار بسيطة مع ChatGPT.

يكشف والدا آدم أنه في أسابيعه الأخيرة، اتخذ ابنهما من روبوت الذكاء الاصطناعي رفيقًا بديلًا عن البشر، يشاركه قلقه ومشاكله في التواصل مع عائلته.

وتظهر سجلات المحادثات، بحسب العائلة، كيف تحول الروبوت من مساعد في الفروض المدرسية إلى ما وصفه الأب بـ”مدرب على الانتحار”. قائلًا: “لولا ChatGPT، لكان ابني هنا اليوم. أنا أؤمن بذلك 100%”، قال مات راين بمرارة.

من مساعد رقمي إلى متهم بالقتل

في دعوى قضائية جديدة قدمت يوم الثلاثاء الماضي، وتمت مشاركتها مع برنامج “TODAY” الشهير، تزعم عائلة راين أن “ChatGPT ساعد آدم بفاعلية على استكشاف طرق الانتحار”.

دعوة قضائية ضد OpenAI

الدعوى المكونة من حوالي 40 صفحة، والمقامة في المحكمة العليا بكاليفورنيا، تضع شركة OpenAI ورئيسها التنفيذي، سام ألتمان، في موضع الاتهام.

وهذه هي المرة الأولى التي يتهم فيها آباء الشركة بشكل مباشر بالقتل الخطأ. وفقًا لـ”.cnn”.

وجاء في نص الدعوى: “على الرغم من إقرار ChatGPT بمحاولة آدم الانتحار وتصريحه بأنه سيفعلها يومًا ما’. لم يقم الروبوت بإنهاء الجلسة أو تفعيل أي بروتوكول طوارئ”.

وتتهم العائلة الشركة بالقتل الخطأ. ووجود عيوب في تصميم المنتج، والتقصير في التحذير من المخاطر المرتبطة به، مطالبين بتعويضات عن وفاة ابنهما، وبإصدار أمر قضائي “لمنع حدوث شيء كهذا مرة أخرى على الإطلاق”.

وأضاف الأب: “بمجرد أن دخلت إلى حسابه، أدركت أن هذا الشيء أقوى وأكثر رعبًا بكثير مما كنت أعرف، لقد كان يستخدمه بطرق لم أتخيل أنها ممكنة. لا أعتقد أن معظم الآباء يدركون قدرات هذه الأداة”.

سباق التكنولوجيا وحواجز الأمان الغائبة

أطلق الإصدار العام لـ ChatGPT في أواخر عام 2022 طفرة عالمية في الذكاء الاصطناعي التوليدي. ما أدى إلى تبني واسع وسريع لروبوتات الدردشة في المدارس، وأماكن العمل وحتى في قطاع الرعاية الصحية.

وفي خضم هذا السباق المحموم بين شركات التكنولوجيا لتطوير الذكاء الاصطناعي. تتعالى المخاوف من أن حواجز الأمان تتخلف كثيرًا عن ركب هذا التطور.

ومع تزايد لجوء الناس إلى روبوتات الدردشة للحصول على الدعم العاطفي والمشورة، سلطت حوادث أخيرة الضوء على قدرتها المحتملة على تغذية الأوهام وخلق شعور زائف بالقرب والاهتمام. وتضيف مأساة آدم موجة جديدة من التساؤلات حول المدى الذي يمكن أن يسببه هذا الذكاء من ضرر حقيقي.

رد OpenAI بين الأسف والوعد بالتحسين

بعد رفع الدعوى، صرح متحدث باسم OpenAI بأن الشركة “تشعر بحزن عميق لوفاة السيد راين. وقلوبنا مع عائلته”. وأضاف: “يتضمن ChatGPT إجراءات وقائية مثل توجيه الأشخاص إلى خطوط المساعدة في الأزمات وإحالتهم إلى موارد حقيقية”.

لكن الشركة اعترفت بوجود ثغرات. قائلة: “لقد تعلمنا بمرور الوقت أن هذه الضمانات يمكن أن تصبح أقل موثوقية في المحادثات الطويلة. حيث قد تتدهور أجزاء من تدريب نموذج الأمان”.

تزامنًا مع الدعوى. نشرت الشركة تدوينة بعنوان “مساعدة الناس عندما يكونون في أمس الحاجة إليها”.

وأوضحت فيها بعض الأنظمة التي تعمل على تحسينها. ومنها: “تعزيز الضمانات في المحادثات الطويلة”. وتحسين كيفية حظر المحتوى. وتوسيع “التدخلات لمزيد من الأشخاص في الأزمات”.